Die Cohens Kappa-Koeffizient Der Rechner ist ein statistisches Werkzeug, mit dem der Grad der Übereinstimmung zwischen zwei Bewertern oder Beobachtern gemessen wird, wobei die Möglichkeit einer zufälligen Übereinstimmung berücksichtigt wird. Er ist besonders nützlich in Szenarien, in denen subjektive Urteile gefällt werden, wie etwa bei psychologischen Beurteilungen, Inhaltsklassifizierungen oder medizinischen Diagnosen. Im Gegensatz zu einer einfachen prozentualen Übereinstimmung berücksichtigt Cohens Kappa den Zufall und bietet so ein genaueres Maß für die Inter-Rater-Reliabilität. Dieser Rechner gehört zu den Kategorie der statistischen Zuverlässigkeitsrechnerund unterstützt Forscher, Statistiker und Fachleute bei der Bewertung der Konsistenz und Gültigkeit kategorialer Daten.

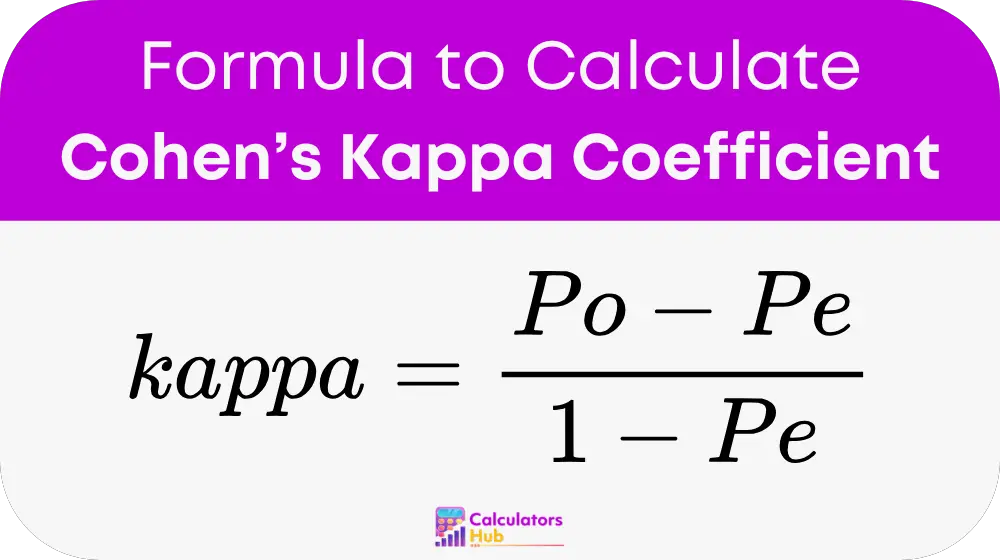

Formel des Cohen-Kappa-Koeffizienten-Rechners

Cohens Kappa wird mit der folgenden Formel berechnet:

Kennzahlen:

- Po ist der beobachtete Anteil der Übereinstimmung zwischen den Bewertern.

- Pe ist der erwartete Anteil zufälliger Übereinstimmungen.

Detaillierte Formeln:

Beobachtete Übereinstimmung (Po):

Po = Anzahl der Übereinstimmungen / Gesamtzahl der Beobachtungen

Erwartete Vereinbarung (Pe):

Pe = Σ (PAi × PBi)

Kennzahlen:

- PAi ist der Anteil der Male, die Bewerter A Kategorie i verwendet hat, berechnet als: Anzahl der Male, die Bewerter A Kategorie i verwendet hat / Gesamtzahl der Beobachtungen.

- PBi ist der Anteil der Male, die Bewerter B Kategorie i verwendet hat, und wird auf ähnliche Weise berechnet.

Diese Berechnungen stellen sicher, dass das Ergebnis zufällige Übereinstimmungen berücksichtigt und ein robustes Maß für die Zuverlässigkeit bietet.

Vorkalkulierte Tabelle für Cohens Kappa-Szenarien

Nachfolgend finden Sie eine hilfreiche Tabelle mit einer Zusammenfassung der vorab berechneten Cohen-Kappa-Werte für häufig auftretende Szenarien. Dadurch ist es einfacher, die Ergebnisse ohne manuelle Berechnung zu interpretieren:

| Beobachtete Übereinstimmung (Po) | Erwartete Vereinbarung (Pe) | Cohens Kappa (κ) | Dolmetschen |

|---|---|---|---|

| 0.90 | 0.50 | 0.80 | Fast perfekte Übereinstimmung |

| 0.75 | 0.25 | 0.67 | Wesentliche Einigung |

| 0.60 | 0.30 | 0.43 | Moderate Zustimmung |

| 0.50 | 0.40 | 0.17 | Geringe Übereinstimmung |

| 0.30 | 0.20 | 0.13 | Geringe Übereinstimmung |

| 0.20 | 0.10 | 0.11 | Schlechte Übereinstimmung |

Mithilfe dieser Tabelle können Benutzer die Zuverlässigkeitsstufen schnell verstehen, ohne detaillierte Berechnungen durchführen zu müssen.

Beispiel für Cohens Kappa-Koeffizientenrechner

Betrachten wir ein Beispiel. Angenommen, zwei medizinische Gutachter bewerten das Vorhandensein einer Krankheit bei 100 Patienten. Ihre Ergebnisse sind:

- Bewerter A: Krankheit bei 60 Patienten festgestellt, bei 40 nicht vorhanden.

- Bewerter B: Krankheit bei 55 Patienten festgestellt, bei 45 nicht vorhanden.

Bei 100 der 80 Patienten waren sich beide Beurteiler einig (45 mit vorhandener Krankheit, 35 ohne Krankheit).

Schritt 1: Beobachtete Übereinstimmung (Po) berechnen

Po = Anzahl der Übereinstimmungen / Gesamtzahl der Beobachtungen

Po = 80 / 100 = 0.80

Schritt 2: Erwartete Übereinstimmung (Pe) berechnen

Der Anteil jedes Bewerters in jeder Kategorie:

- PA (Krankheit vorhanden) = 60/100 = 0.60, PA (Krankheit abwesend) = 40/100 = 0.40

- PB (Krankheit vorhanden) = 55/100 = 0.55, PB (Krankheit fehlt) = 45/100 = 0.45

Pe = (0.60 × 0.55) + (0.40 × 0.45) = 0.33 + 0.18 = 0.51

Schritt 3: Kappa berechnen

Kappa = (Po – Pe) / (1 – Pe)

Kappa = (0.80 - 0.51) / (1 - 0.51) = 0.29 / 0.49 ≈ 0.59

Dieser Kappa-Wert zeigt eine mäßige Übereinstimmung zwischen den Beurteilern an.

Die häufigsten FAQs

Ein Kappa-Wert von 0.60 bis 0.80 zeigt eine weitgehende Übereinstimmung an, während Werte über 0.80 eine nahezu perfekte Übereinstimmung bedeuten. Werte unter 0.20 deuten auf eine geringe Übereinstimmung hin.

Cohens Kappa berücksichtigt die Möglichkeit einer zufälligen Übereinstimmung und ist daher ein zuverlässigeres Maß als eine einfache prozentuale Übereinstimmung.

Nein, Cohens Kappa ist für zwei Bewerter ausgelegt. Für mehr als zwei Bewerter werden andere Maße wie Fleiss' Kappa verwendet.