Dieses spezielle Tool hilft Forschern und Statistikern, indem es ein standardisiertes Maß für die Übereinstimmung zwischen Bewertern bereitstellt, das über den Zufall hinausgeht. Es ist besonders nützlich in Bereichen wie Psychologie, Medizin und jeder Forschung, die Beobachtungsdaten verwendet.

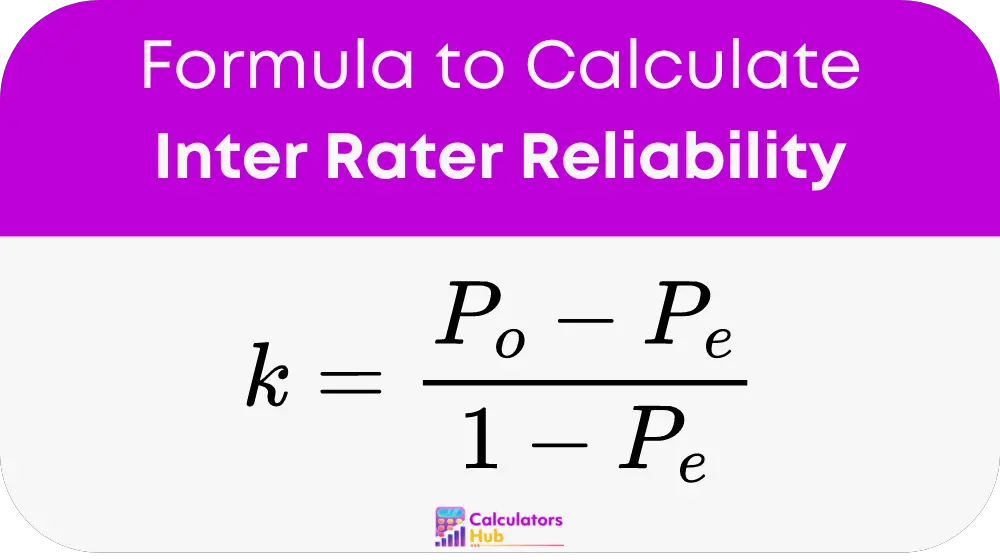

Formel des Inter-Rater-Zuverlässigkeitsrechners

Das Haupt Die zur Messung der Zuverlässigkeit zwischen Bewertern verwendete Formel ist Cohens Kappa (k), die den Grad der Übereinstimmung zwischen zwei Bewertern quantifiziert. Die Formel lautet:

Kennzahlen:

- P_o ist die beobachtete Übereinstimmung zwischen den Bewertern.

- P_e ist die zufällig erwartete Übereinstimmung.

Schritt-für-Schritt-Anleitung zur Verwendung des Inter-Rater-Zuverlässigkeitsrechners

Erstellen Sie eine Kontingenztabelle:

Erstellen Sie eine Tabelle, um unterschiedliche Bewertungen aufzuzeichnen, die von zwei Bewertern vergeben wurden. Zum Beispiel:

| Bewerter B: Ja | Bewerter B: Nein | |

|---|---|---|

| Bewerter A: Ja | a | b |

| Bewerter A: Nein | c | d |

Berechnen Sie die beobachtete Übereinstimmung (P_o):

P_o = (a + d) / (a + b + c + d)

Berechnen Sie die erwartete Vereinbarung (P_e):

P_e = ((a + b) * (a + c) + (c + d) * (b + d)) / (a + b + c + d)^2

Berechnen Sie Cohens Kappa:

Setzen Sie die Werte von oben in die Kappa-Formel von Cohen ein, um das Ergebnis zu erhalten.

Tabelle der allgemeinen Begriffe und relevanten Berechnungen

| Bedingungen | Definition |

|---|---|

| Zuverlässigkeit zwischen Bewertern | Ein Maß dafür, wie konsistent unterschiedliche Bewerter dieselben Phänomene bewerten. |

| Cohens Kappa (k) | Eine Statistik, die die Interbewerter-Zuverlässigkeit für kategoriale Elemente misst. |

| Beobachtete Übereinstimmung (P_o) | Der Anteil der Male, in denen die Bewerter zustimmen. |

| Erwartete Vereinbarung (P_e) | Die Wahrscheinlichkeit, dass die Bewerter zufällig einer Meinung sind. |

| Kontingenztabelle | Eine Matrix zur Berechnung der Übereinstimmungen und Meinungsverschiedenheiten zwischen Bewertern. |

Diese Tabelle bietet eine schnelle Referenz zum Verständnis der wichtigsten Begriffe und Berechnungen, die bei der Bewertung der Zuverlässigkeit zwischen Bewertern verwendet werden, und hilft dabei, den methodischen Ansatz des Zuverlässigkeitsrechners zu verstehen.

Beispiel eines Inter-Rater-Zuverlässigkeitsrechners

Szenario:

Zwei Psychologen untersuchen eine Gruppe von Patienten auf eine bestimmte psychische Erkrankung und müssen dabei jeden Patienten entweder als „hohes Risiko“ oder als „geringes Risiko“ einstufen. Nach der Beurteilung von 10 Patienten zeichneten sie ihre Beurteilungen wie folgt auf:

- Bewerter A: Hohes Risiko: 5 Patienten, niedriges Risiko: 5 Patienten

- Beurteiler B: Hohes Risiko: 4 Patienten, niedriges Risiko: 6 Patienten

Ihre Einschätzungen lauten konkret:

| Patienten ID | Bewertung durch Bewerter A | Bewertung durch Bewerter B |

|---|---|---|

| 1 | Hohes Risiko | Hohes Risiko |

| 2 | Niedriges Risiko | Niedriges Risiko |

| 3 | Hohes Risiko | Niedriges Risiko |

| 4 | Niedriges Risiko | Niedriges Risiko |

| 5 | Hohes Risiko | Hohes Risiko |

| 6 | Niedriges Risiko | Hohes Risiko |

| 7 | Hohes Risiko | Hohes Risiko |

| 8 | Niedriges Risiko | Niedriges Risiko |

| 9 | Hohes Risiko | Niedriges Risiko |

| 10 | Niedriges Risiko | Niedriges Risiko |

Berechnungen:

Erstellen Sie eine Kontingenztabelle:

| Beurteiler B: Hohes Risiko | Beurteiler B: Geringes Risiko | |

|---|---|---|

| Bewerter A: Hohes Risiko | 3 (a) | 2 (b) |

| Bewerter A: Geringes Risiko | 1 (c) | 4(d) |

Berechnen Sie die beobachtete Übereinstimmung (P_o):

P_o = (a + d) / (a + b + c + d) = (3 + 4) / 10 = 0.7

Berechnen Sie die erwartete Vereinbarung (P_e):

P_e = [((a + b) * (a + c) + (c + d) * (b + d)) / (a + b + c + d)^2]

= [((3 + 2) * (3 + 1) + (1 + 4) * (2 + 4)) / 10^2]

= [20 + 30] / 100 = 0.5

Berechnen Sie Cohens Kappa:

k = (P_o – P_e) / (1 – P_e) = (0.7 – 0.5) / (1 – 0.5) = 0.4

Dieser Cohen-Kappa-Wert von 0.4 deutet auf eine moderate, nicht zufällige Übereinstimmung zwischen den beiden Bewertern hin.

Die häufigsten FAQs

Es misst die Übereinstimmung zwischen verschiedenen Bewertern und stellt so sicher, dass die Bewertungen für verschiedene Beobachter konsistent sind.

Cohens Kappa geht davon aus, dass die Übereinstimmung zufällig auftritt, was ein genaueres Maß für die Zuverlässigkeit liefert als eine einfache prozentuale Übereinstimmung.